我差点以为是我!这个3D人体生成模型,很神奇。也可以自己换个姿势。

发布日期:2022-12-06 作者:康为 点击:

丰富的色彩来自奥菲斯| QbitAI的量子位报告,微信官方账号

很多3D人体模型很厉害,但是“裸奔”总是不可避免的。

像打造一个真正的人类“头像”模型,衣服和头发缺一不可。

然而,这些元素的精确3D数据非常稀少且难以获得。

三星AI中心(莫斯科)和其他团队的技术人员一直致力于这项研究,最后他们开发了这样一个模型:

生成的3D人物,穿着他们原来的衣服和发型,也毫无保留的呈现出来。

乍一看,“像个真人”。

更好的是,不用模特示范,模型可以“举一反三”,摆出各种姿势!

效果是这样的:

模型名为StylePeople。

让我们看看是怎么发生的!模型(神经修整模型)

其实不仅仅是“裸奔”,很多3D人体还是“刚性”的:模特摆什么姿势,模型就跟什么姿势。

就像之前一样,隐函数生成的三维人体模型可以高度还原模特的着装和发型,但是人物的姿势还是不够灵活,只能从原模特的几个特定视角生成。

赞美诗也是这个团队的研究成果。

所以在为3D人体模型还原衣服的颜色、褶皱、发型的同时,还需要保证人物的姿势能够举一反三。

因此,研究者采用多边形实体网格建模和神经纹理相结合的方法。

多边形负责控制和建模人体的粗略几何姿态,神经渲染负责添加衣服和头发。

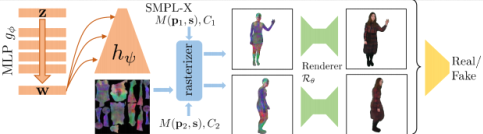

首先,他们设计了一个神经包扎模型模型,它结合了可变形网格建模和神经渲染,如下图所示。

左栏显示了可视化的前三个PCA成分。

第二列和第三列是叠加在SMPL-X建模的人体网格上的“人体头像”的纹理

列4和列5是通过光栅化渲染网络渲染的结果。

能优雅地处理宽松的衣服和长发以及复杂的穿衣结构!

接下来,基于上述神经敷料模型,研究人员创造了一个可以生成“芬布迪”的3D人体模型。

最终一代架构是StyleGANv2和神经敷料的结合。

在StyleGAN部分,神经纹理由反向传播算法生成,然后叠加在SMPL-X网格上,由神经渲染器渲染。

在对抗性学习中,鉴别者将每一对图像视为同一个人。提高从视频和少量图像生成3D人体模型的技术水平。

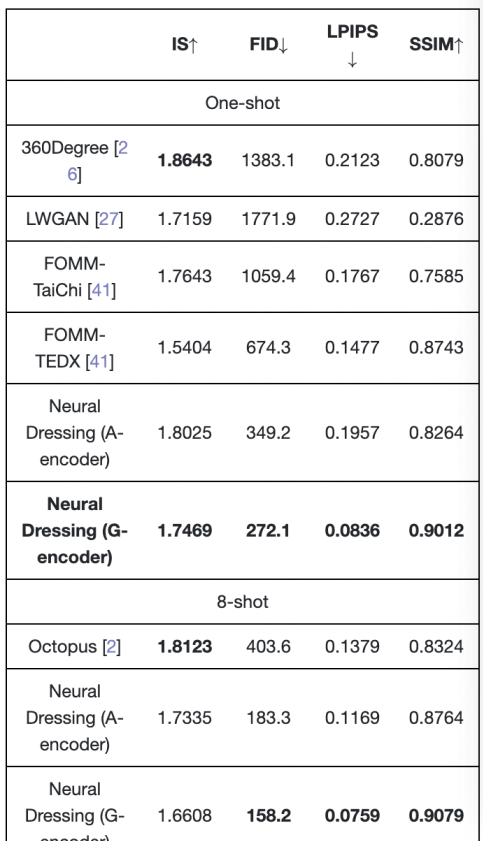

在对神经包扎方法效果的验证中,研究人员首先基于视频资料对3D模型生成结果进行了评估。

如文章开头的图片所示,左边是样本源帧,其余图片是左边视频人物的“头像”。在简单的增强现实程序背景下,呈现出模型之前从未摆过的各种姿势。

接下来,基于小样本图像资料评估神经包扎效果。

研究人员使用只有两个人的人物快照数据集,将他们的神经包扎方法与其他方法(如360度等)进行比较。,请参见表)。

衡量生成模型质量的指标有LPIPS(感知相似度)、SSIM(结构相似度)、FID(真实样本与生成样本在特征空间的距离)、IS(清晰度和多样性评分)。

结果表明,该方法在各项指标上都有优势,

除了IS,影响不大,因为和视觉质量的相关性最小。

最后,团队表示,他们的模型生成效果(如下图)仍然受到当前样本数据规模和质量的限制,未来的工作将致力于提高这种模型的数据利用率。

有兴趣的同学可以随时关注团队的研究进展。

参考链接:

[1]https://arxiv . org/ABS/2104.08363

—结束—

量子qbitai头条号签约

关注我们,第一时间获悉前沿科技动态。